Durante años, la inteligencia artificial avanzó principalmente dentro de pantallas y servidores. Chatbots, modelos generativos y sistemas de recomendación dominaron la conversación tecnológica. Pero en 2026 la industria está comenzando a moverse hacia algo mucho más ambicioso: darle sentidos físicos a la IA.

La nueva carrera tecnológica ya no consiste solamente en crear modelos más inteligentes, sino en desarrollar máquinas capaces de ver, tocar, medir, interpretar el entorno y reaccionar en tiempo real. Y en el centro de esta transformación aparecen los sensores.

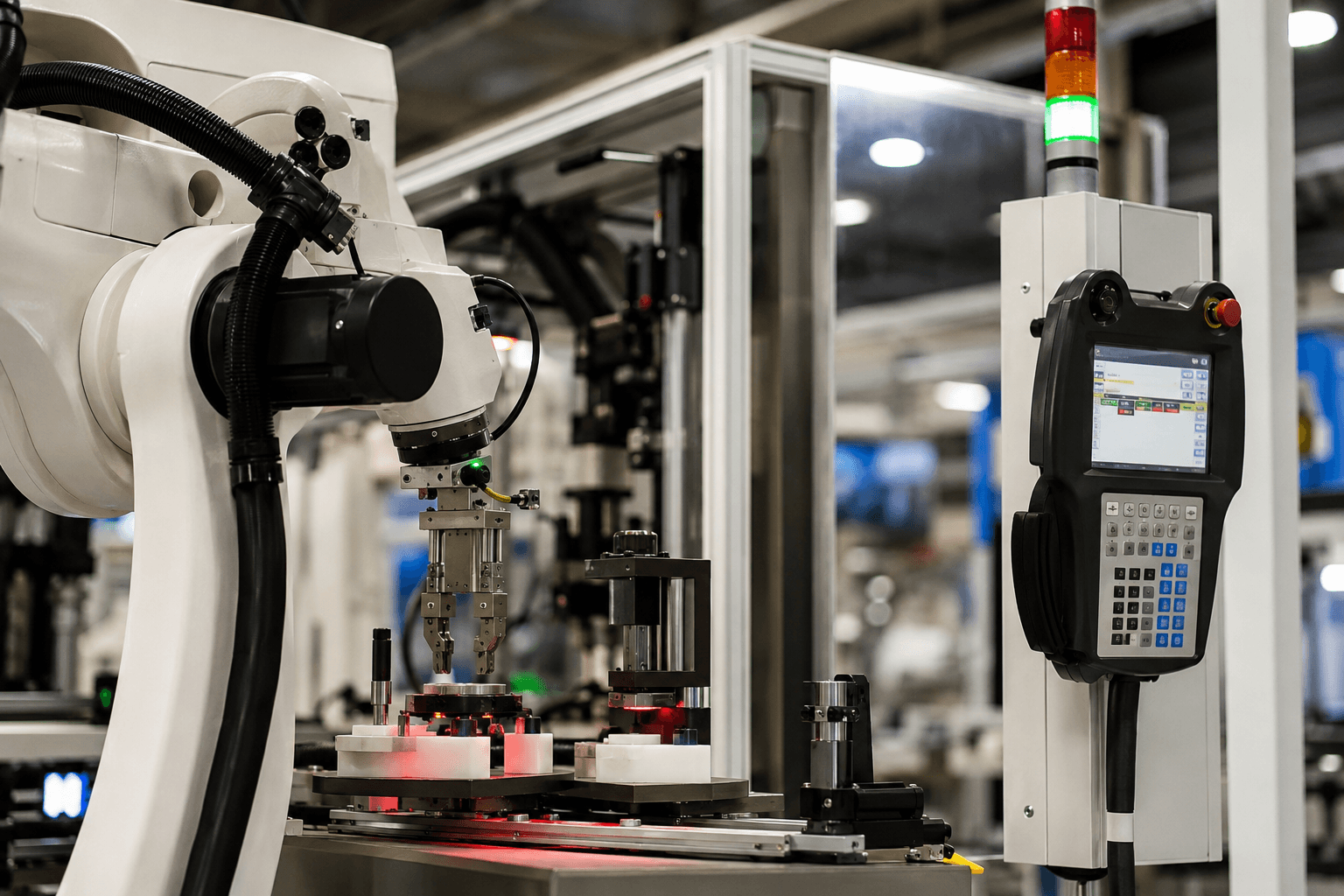

Empresas de semiconductores, robótica e IoT están invirtiendo millones de dólares en tecnologías capaces de convertir robots y sistemas industriales en plataformas perceptivas avanzadas. Lo que antes parecía ciencia ficción ahora está entrando a fábricas, almacenes y laboratorios industriales.

Uno de los movimientos más llamativos ocurrió recientemente cuando Lattice Semiconductor anunció una colaboración con Texas Instruments para acelerar sistemas de Edge AI orientados a robótica industrial y aplicaciones inteligentes en tiempo real.

La propuesta no es menor: integrar sensores mmWave, cámaras industriales y procesamiento FPGA de baja latencia para que robots industriales puedan “entender” el entorno casi instantáneamente.

El verdadero problema de la IA industrial

Aunque el boom de la IA ha sido enorme, existe una limitación crítica: los modelos necesitan datos del mundo real.

Un robot puede tener un modelo de inteligencia artificial extremadamente avanzado, pero si no posee sensores confiables, rápidos y precisos, sigue estando “ciego”.

Ese cuello de botella está impulsando una nueva generación de tecnologías:

- LiDAR 4D

- sensores táctiles flexibles

- visión terahertz

- sensores químicos

- sensores olfativos

- radar mmWave

- cámaras depth sensing

- fusión multisensorial con IA

En otras palabras, la industria está construyendo los “órganos sensoriales” de la inteligencia artificial física.

Y el crecimiento está siendo acelerado por algo clave: Edge AI.

¿Por qué el Edge AI está cambiando todo?

Hasta hace pocos años, la mayoría de sistemas inteligentes dependían de enviar información a la nube para procesarla. El problema es que eso introduce latencia, costos y vulnerabilidades.

En aplicaciones industriales, unos pocos milisegundos pueden marcar la diferencia entre:

- detectar una falla,

- evitar una colisión,

- prevenir una fuga,

- o perder un proceso completo.

Por eso las empresas están apostando por Edge AI: inteligencia artificial ejecutándose directamente en dispositivos cercanos al sensor.

La nueva arquitectura presentada por Lattice y Texas Instruments busca precisamente eso: procesar datos de radar y visión en tiempo real utilizando FPGA de bajo consumo y pipelines sincronizados de sensores.

Esto permitirá que robots industriales:

- reaccionen más rápido,

- operen con menor dependencia de la nube,

- y ejecuten tareas complejas con mayor autonomía.

El auge de los sensores táctiles inteligentes

Pero la revolución no termina en cámaras y radares.

En Hannover Messe 2026, la empresa alemana FLEXOO GmbH mostró sensores táctiles ultradelgados capaces de convertir superficies robóticas en piel sensorial inteligente.

Estos sensores permiten que robots:

- detecten presión,

- identifiquen contacto incorrecto,

- interpreten interacción física,

- y generen datos para entrenamiento de IA.

Esto es especialmente importante para robots colaborativos que trabajan junto a humanos.

Hasta ahora, muchos robots industriales eran extremadamente precisos, pero “torpes” al interactuar con objetos delicados o variables. Con sensores táctiles avanzados, un robot podría:

- manipular componentes electrónicos frágiles,

- ajustar fuerza automáticamente,

- o detectar anomalías físicas invisibles para cámaras tradicionales.

La industria comienza a entender que la visión artificial sola no es suficiente.

LiDAR en color: el posible fin de las cámaras tradicionales

Mientras tanto, otra tecnología está generando enorme expectativa: los nuevos sistemas LiDAR en color.

Recientemente se presentó un sensor capaz de capturar simultáneamente profundidad y color sin depender de sensores CMOS tradicionales.

En lugar de trabajar con píxeles convencionales, estos sistemas crean nubes de puntos tridimensionales extremadamente detalladas.

Las implicaciones son enormes:

- vehículos autónomos más precisos,

- robots con percepción espacial avanzada,

- drones inteligentes,

- automatización industrial de alta precisión,

- e incluso nuevas formas de fotografía computacional.

Empresas como Hesai Technology y Aeva están apostando fuerte por esta nueva generación de percepción espacial.

El nacimiento de la “nariz electrónica”

Uno de los desarrollos más sorprendentes es el avance de la machine olfaction o percepción química artificial.

Investigadores y startups están desarrollando sensores capaces de detectar compuestos químicos complejos mediante IA.

La idea parece salida de una película futurista:

máquinas capaces de “oler”.

Pero las aplicaciones industriales son enormes:

- detección temprana de fugas,

- monitoreo ambiental,

- diagnóstico médico,

- control de calidad,

- mantenimiento predictivo,

- y seguridad industrial.

Incluso investigadores en India desarrollaron recientemente un sensor portátil que detecta marcadores relacionados con diabetes a partir del aliento humano.

Esto podría abrir una nueva generación de sensores biomédicos no invasivos y ultraeconómicos.

La fábrica autónoma ya no es teoría

Todas estas tecnologías están convergiendo hacia un mismo objetivo: la fábrica autónoma.

En Hannover Messe 2026, uno de los mensajes más repetidos fue que la IA industrial está dejando atrás la etapa experimental y entrando finalmente en despliegues reales a gran escala.

Las nuevas plantas industriales están comenzando a integrar:

- sensores distribuidos,

- análisis predictivo,

- gemelos digitales,

- mantenimiento autónomo,

- y decisiones automatizadas.

Esto está cambiando el rol tradicional del operario industrial.

El futuro cercano probablemente no será una fábrica completamente vacía de humanos, pero sí un entorno donde:

- menos personas supervisen más sistemas,

- la interpretación de datos sea más importante que la operación manual,

- y la integración entre IA y sensores sea el núcleo de la productividad.

El negocio detrás de la revolución sensorial

La carrera por desarrollar sensores inteligentes también está moviendo enormes cantidades de dinero.

El crecimiento explosivo de centros de datos de IA, robótica avanzada y automatización industrial está impulsando la demanda global de semiconductores especializados.

Y esto apenas comienza.

La próxima década podría estar dominada no solo por empresas de software de IA, sino también por compañías capaces de fabricar:

- sensores más pequeños,

- más rápidos,

- más precisos,

- y capaces de operar directamente con inteligencia artificial embebida.

La conclusión es clara:

la próxima gran revolución tecnológica no será solamente la IA.

Será la combinación entre inteligencia artificial y percepción física del mundo.